تحذير خطير من استخدام التكنولوجيا في التلاعب بالهويات عبر المكالمات الهاتفية بواسطة الذكاء الاصطناعي

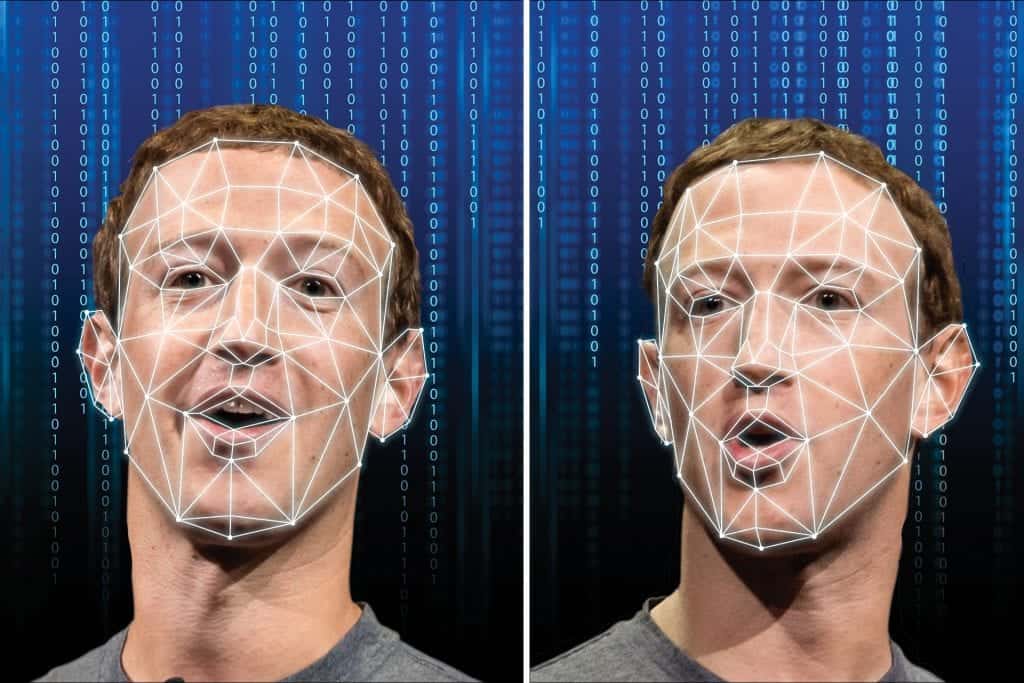

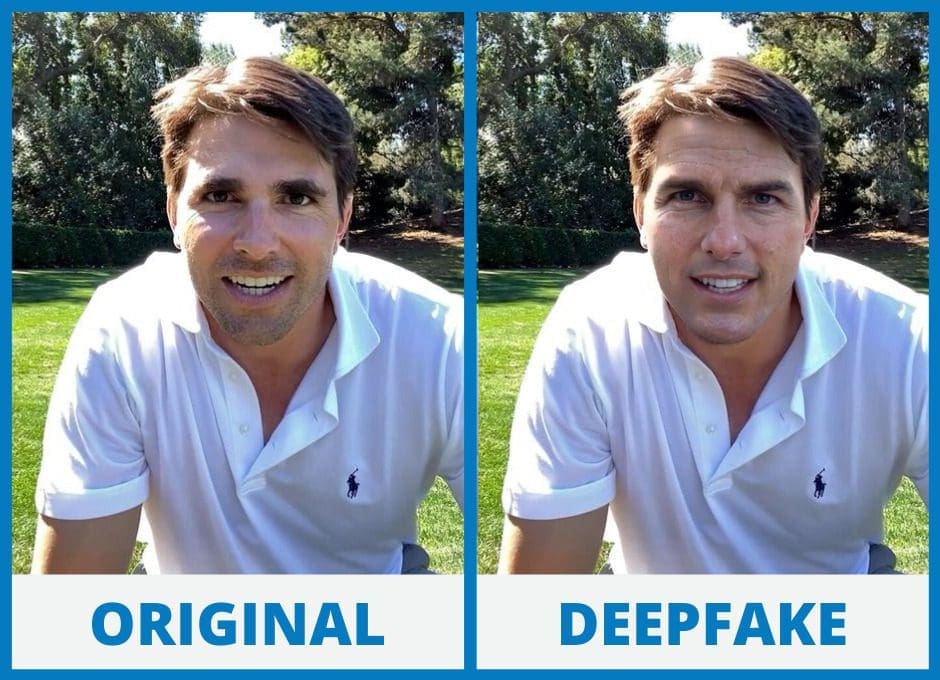

حذر خبراء أمن سيبراني من خطورة استخدام التكنولوجيا الذكية للمكالمات الهاتفية التي تتم من خلال الذكاء الإصطناعي، حيث يمكن للمهاجمين أن ينتحلوا هويات أشخاص قريبين من الضحايا لغرض الإحتيال وسرقة المعلومات الحساسة والحسابات البنكية، ووفقاً لتقرير نشرته صحيفة “ذا صن” البريطانية فإن تقنية Deepfake المعروفة بالتلاعب بالصوت والصور بإستخدام الذكاء الاصطناعي قد أتاحت للمهاجمين تنفيذ عمليات احتيالية عبر المكالمات الهاتفية بشكل يشد الإنتباه إلى خطورة هذه الظاهرة.

صورة مارك زوكربيرغ- مصدر الصورة:: Analytics Insight

كيف يستخدم المحتالون الذكاء الإصطناعي لسرقة المعلومات

يتم حالياً استخدام هذه التقنية من قبل محتالين لتنفيذ هذه العمليات، حيث يقومون بإنتحال شخصيات قريبة من الأشخاص المستهدفين بهدف سرقتهم أو الحصول على معلوماتهم من خلال تقليدهم، وأوضحت الصحيفة أن المحتالين قد يقومون بإنتحال هويات رؤساء الشركات أو أفراد عائلات الأشخاص عن طريق تقليد أصواتهم، ومن خلال هذا الإحتيال يمكنهم إقناع الضحايا بشكل كبير عندما يطلبون منهم تحويل أموال أو تقديم معلومات أخرى تستخدم في أنشطة احتيالية أو ضارة.

واكتشفت شركة Mandiant للأمن السيبراني التي تمتلكها جوجل أن أول تقنية للتزييف لأغراض الإحتيال تم بيعها في 17 أغسطس الماضي، وهذا يجعل أي شخص يمتلك هاتف ذكي أو جهاز كمبيوتر عرضة لمثل هذا النوع من الجرائم السيبرانية.

الذكاء الإصطناعي يزيد من واقعية الإحتيال

أشارت شركة Mandiant إلى أن المحتوى الذي يتم إنشاؤه بواسطة الذكاء الإصطناعي قد يكون واقعياً للغاية، مما يعزز من قوة إقناعه للجمهور المستهدف بشكل أكبر من المحتوى السابق الذي كان ينتج بدون استخدامه، وأوضحت الشركة أن المحتالين يعملون على جعل تقنية التزييف العميق أو Deepfake تظهر وكأنها شخصية أكثر بطبيعتها، وعادةً يكون مقنعاً لدرجة كبيرة، مما يجعل أي شخص عرضة للوقوع في هذه الحيلة، بما في ذلك حتى رؤساء الشركات الكبرى.

تزايد استخدام Deepfake في مواد إباحية مزيفة

تتصاعد مخاطر تقنية التزييف العميق (Deepfake) بشكل ملحوظ وتشكل تهديد خطير على الأمن العام والمجتمعات، فقد أفاد تقرير سابق صادر عن شركة مراقبة الوسائط الرقمية “Sensity” بأن تقنية Deepfake تستخدم بشكل متزايد لنشر مقاطع فيديو إباحية مزيفة على الإنترنت، وأظهر البحث أن عدد مقاطع الفيديو المزيفة تقريباً يتضاعف كل ستة أشهر.

على الرغم من أن تقنية Deepfake تم تطويرها في الأصل لأغراض سينمائية وإعلانية، إلا أن تقريراً آخر لشركة Sensity أشار إلى أن معظم مقاطع الفيديو المزيفة على الإنترنت تتعلق بمواد إباحية بنسب تصل إلى 95% وتشمل معظمها النساء بنسبة 90% تقريباً، وتشكل مقاطع Deepfake تهديداً حيث من المتوقع أن تنفق الشركات مبالغ ضخمة على حلول الأمن السيبراني لمواجهة هذه التحديات.